产品概述

描述

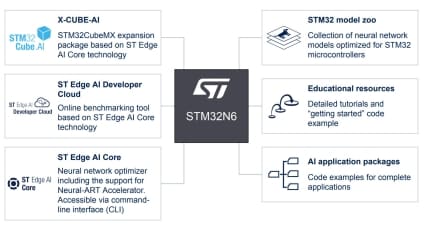

STM32N6 AI生态系统 (STM32N6-AI) 是意法半导体推出的工具和资源集合,旨在支持在高性能STM32N6系列微控制器上开发和部署AI模型。

STM32N6微控制器 (MCU) 首次集成了意法半导体专有的Neural-ART加速器神经处理单元 (NPU),在AI/ML性能上实现了重大突破。

STM32N6-AI工具专为简化开发流程而设计,确保开发人员能够实现最理想的性能和效率。这些工具支持“自带数据”(BYOD) 和“自带模型”(BYOM) 两种开发方式,以满足用户的不同开发实践和偏好。

例如,STM32 Model Zoo(github.com/STMicroelectronics/stm32ai-modelzoo)、ST Edge AI Developer Cloud (STEDGEAI-DC)、STM32Cube.AI (X-CUBE-AI) 和ST Edge AI Core (STEdgeAI-Core) 等工具,充分发挥了STM32N6在AI和计算机视觉 (CV) 应用方面的潜力。

此外,STM32N6-AI还提供多种软件包,作为用户AI项目的示例和起点:

- AI应用:包括简单的计算机视觉 (CV) 和音频应用(如人物检测或图像分类),以及更复杂和优化的应用(如姿势估计、实例分割、手部关键点检测和音频场景识别)。

- 视频应用:展示完整的应用场景,包括H264编码和通过USB视频设备等级码流将数据输出到PC。

总体而言,STM32N6-AI提供了一个完整的软件和工具生态系统,帮助开发人员利用STM32N6在边缘构建下一代机器学习应用。STM32N6中嵌入的Neural-ART加速器NPU专为高效处理AI推理任务而设计,可显著加速NN模型的执行。这种整合使微控制器上的边缘AI应用变得更加实用和普及,为广泛的应用场景提供了强大、高效且可扩展的解决方案。

Neural-ART加速器由意法半导体的Edge AI Core全面支持,包括STM32Cube.AI和ST Edge AI Developer Cloud。这些工具能够优化NN模型,并生成由NPU在硬件中执行的代码。通过分析神经网络、准备数据并将其运算符映射到适当的硬件资源,这些工具可以轻松发挥NPU的全部潜力,实现优化的AI加速性能。此外,这些工具还支持Keras、TensorFlow™和ONNX等主流AI框架模型,确保AI开发流程的顺畅和高效。

意法半导体边缘AI套件

STM32N6 AI生态系统的所有工具和软件包均属于意法半导体ST Edge AI Suite。该套件整合了多种软件工具,旨在简化嵌入式AI应用的开发和部署。该综合套件支持从数据收集到在硬件最终部署的整个机器学习算法和神经网络模型的优化和部署流程,简化了跨学科领域的专业人士的工作流程。

意法半导体边缘AI套件支持意法半导体的多种产品,包括STM32微控制器和微处理器、Neural-ART加速器、Stellar微控制器以及智能传感器。

作为推动边缘AI技术普及化的战略举措,意法半导体边缘AI套件为希望在嵌入式系统中高效利用AI的开发人员提供了强大的资源。

-

All features

- STM32Cube.AI (X-CUBE-AI):

- 用于优化NN模型的桌面工具(STM32CubeMX插件)

- 自动生成适用于STM32微控制器的C代码

- ST Edge AI Developer Cloud (STEDGEAI-DC):

- 在线基准测试平台,用于在Board Farm中在线托管的STM32开发板上对AI性能(推理时间、内存占用)进行基准测试。

- 自动生成适用于STM32微控制器的C代码

- 通过REST API实现流程自动化

- ST Edge AI Core (STEdgeAI-Core):

- 用于优化NN模型的命令行接口 (CLI)

- 自动生成适用于STM32微控制器的C代码

- STM32 Model Zoo:

- 提供经过精心优化的AI模型集及相关性能、即用型应用示例,以及用于模型训练、评估、量化、基准测试和部署的脚本。

- 通过REST API使用ST Edge AI Developer Cloud服务

- 应用包:

- 提供多个AI应用的优化源代码

- 在用户的开发板上无缝实施

- 入门代码示例:

- 简单的AI代码示例和教程,介绍如何使用意法半导体Neural-ART加速器实现AI应用

- 可选链接至STM32 Model Zoo资源

- 提供丰富工具以满足用户的配置和目标

- Neural-ART加速器与AI软件生态系统的无缝集成,确保了AI应用性能的优化。

- 用户可轻松获取模型选择、训练脚本及关键模型指标,可直接用于基准测试

- 基于Python™脚本 (REST API) 的ML自动化基准测试服务

- 丰富的使用案例和应用代码示例,助您快速在MCU上开启AI应用开发

- 原生支持多种深度学习框架,如Keras和TensorFlow™ Lite,同时兼容所有可导出为ONNX标准格式的框架,包括PyTorch™、MATLAB®等

- 免费易用的许可条款

- STM32Cube.AI (X-CUBE-AI):